Vivemos a era da Inteligência Artificial. De ferramentas de produtividade a assistentes pessoais, passando por sistemas de recomendação, segurança pública, marketing, RH e muito mais. A IA está presente em praticamente todos os setores da sociedade.

Mas esse avanço traz um dilema cada vez mais urgente: estamos usando a IA para proteger dados ou para invadir privacidades?

A resposta não é simples. De um lado, temos avanços incríveis em automação, personalização e eficiência. De outro, sistemas capazes de rastrear, cruzar e inferir dados pessoais com precisão assustadora — muitas vezes sem o consentimento real dos usuários.

O resultado é um cenário onde a linha entre consentimento informado e vigilância constante se torna cada vez mais tênue.

O paradoxo do consentimento

Quantas vezes você já clicou em “Aceito os termos de uso” sem ler uma linha sequer? Isso é mais comum do que parece. Segundo uma pesquisa da Cisco Consumer Privacy Survey 2023, 81% dos usuários já abandonaram um serviço digital por preocupações com dados pessoais, mas apenas 9% entendem totalmente como seus dados são usados pelas empresas.

Esse paradoxo revela um problema central: o consentimento, hoje, é mais simbólico do que real. As políticas de privacidade são longas, complexas e muitas vezes intencionalmente vagas. Enquanto isso, algoritmos aprendem e evoluem com base em cada clique, deslize e curtida.

E o mais preocupante: mesmo quando o usuário não fornece dados diretamente, a IA pode inferi-los com alta precisão. Um estudo da Universidade de Stanford, ainda em 2015, mostrou que, com somente 300 curtidas no Facebook, um algoritmo pode prever com mais precisão sua personalidade do que seu parceiro(a). Imagine agora, 10 anos depois.

O impacto da vigilância algorítmica

Na prática, isso significa que vivemos sob uma forma de vigilância quase invisível. Aplicativos coletam localização em tempo real, escutam conversas para “melhorar a experiência” e monitoram padrões de comportamento para antecipar ações. Plataformas de e-commerce preveem o que você vai querer comprar antes mesmo de você saber que quer. E tudo isso baseado em dados — seus dados.

Governos e empresas estão construindo perfis altamente detalhados das pessoas, levantando questões sérias sobre autonomia, liberdade e direitos civis. Diferentes regimes e países estão usando a IA para monitorar cidadãos, construir sistemas de pontuação de crédito e reconhecimento facial.

Além disso, os modelos de IA precisam de grandes volumes de dados para treinar e melhorar. Isso gera uma corrida pelo acúmulo de informações — muitas vezes sem transparência ou controle adequado.

A legislação corre atrás (mas continua longe)

A criação da Lei Geral de Proteção de Dados (LGPD) no Brasil e do Regulamento Geral sobre a Proteção de Dados (GDPR) na Europa foi um grande passo.

Essas legislações exigem consentimento explícito, transparência no uso dos dados e garantem aos usuários o direito de saber como suas informações estão sendo utilizadas.

Mas a velocidade com que a IA evolui supera a capacidade dos legisladores de acompanhar. A LGPD, por exemplo, ainda não aborda profundamente os riscos específicos da IA Generativa, como a criação de deepfakes, perfis falsos ou manipulação automatizada de decisões.

No Brasil, desde o ano passado, está no Congresso a lei que regulamenta a IA no país, mas com pouco avanço. Discutimos sobre esse tema no Futurus, com dois especialistas no tema:

Além disso, grande parte dos usuários ainda não conhece seus direitos, o que dificulta a cobrança por práticas mais éticas e seguras.

O que podemos fazer?

A responsabilidade é compartilhada entre empresas, governos e usuários. Algumas boas práticas incluem:

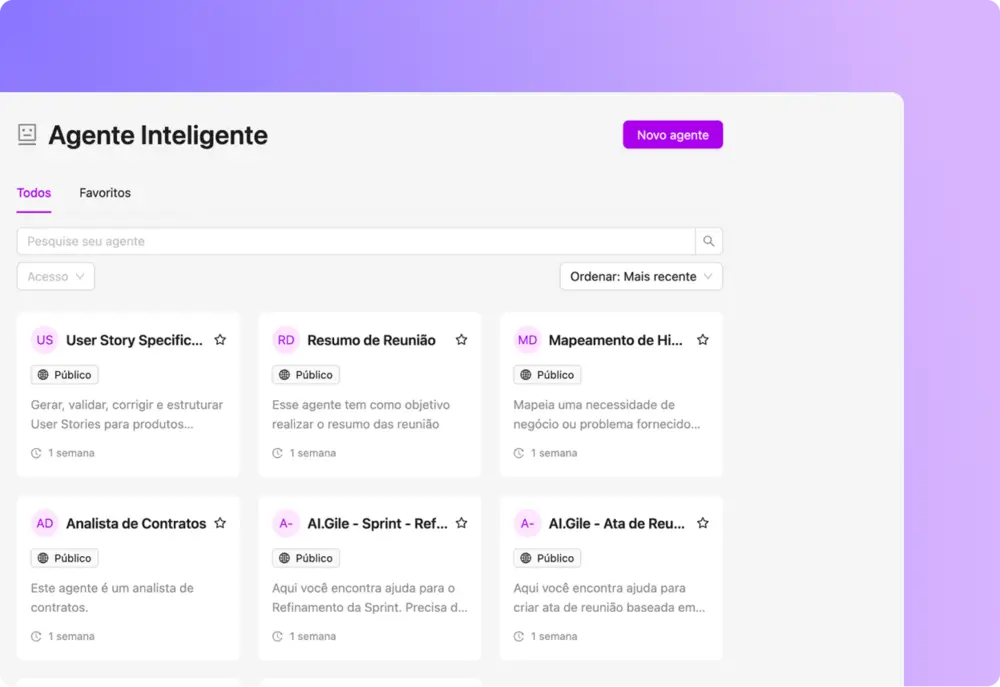

- Investimento em IA explicável (Explainable AI), que permite compreender como decisões automatizadas são tomadas;

- Auditorias regulares em sistemas baseados em IA, especialmente os que tratam dados sensíveis;

- Campanhas educativas para empoderar usuários sobre seus direitos digitais;

- Design centrado na privacidade, aplicando o conceito de Privacy by Design desde a concepção de sistemas;

- Transparência algorítmica, com documentação clara e acessível sobre como os modelos operam e aprendem.

Mas, acima de tudo, é necessário um debate público constante sobre os limites éticos da tecnologia. O avanço da IA é inevitável. Cabe a nós decidirmos os princípios que devem guiá-lo. Falamos neste artigo sobre a importância da ética no desenvolvimento inicial de qualquer modelo de IA.

Conclusão: Estamos realmente seguros?

A Inteligência Artificial transformou a maneira como lidamos com dados e, com isso, trouxe consigo uma série de dilemas éticos e riscos reais. A promessa de uma era mais eficiente, automatizada e personalizada esbarra em questões profundas sobre privacidade, consentimento e vigilância.

Estamos mais monitorados do que nunca, e muitas vezes nem percebemos.

Afinal, em um mundo onde algoritmos sabem mais sobre nós do que nós mesmos, quem está realmente no controle? E mais importante: estamos realmente seguros?

.webp)